1. Rechtzeitig umsetzen: EU AI Act 2025

1.1 Überblick über das Gesetz

Die „Verordnung des Europäischen Parlaments und des Rates zur Festlegung harmonisierter Vorschriften für künstliche Intelligenz“ – kurz EU AI Act – soll einen einheitlichen Rechtsrahmen für die Entwicklung und Nutzung von KI schaffen. Ziel ist eine menschenzentrierte, transparente und sichere KI, die Grundrechte, Datenschutz und Rechtsstaatlichkeit wahrt. Die EU fördert KI – aber nur unter klaren ethischen Regeln.

Für Unternehmen bedeutet das: Sobald KI im Einsatz ist – egal in welcher Branche – greifen die Regeln des EU AI Act. Und ja, das klingt erstmal nach viel Bürokratie.

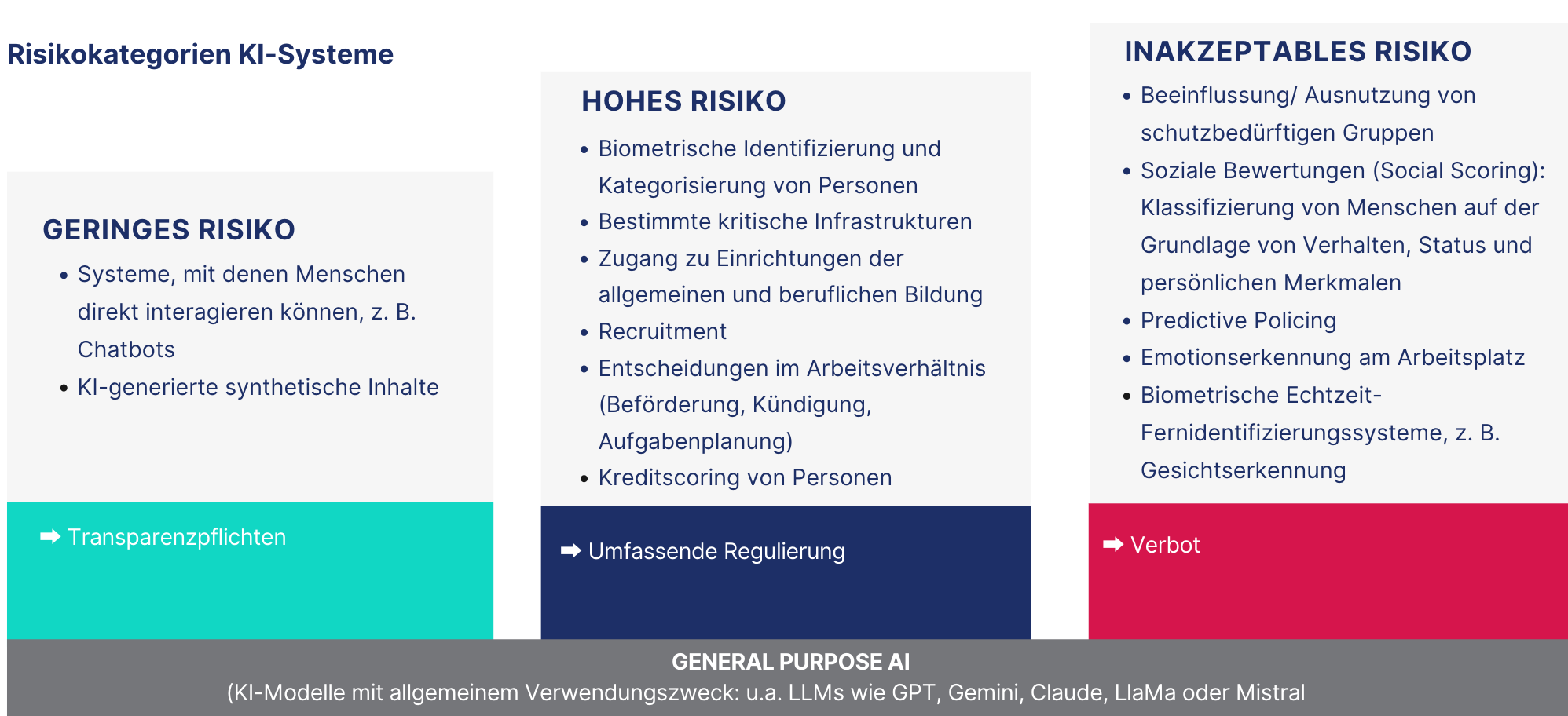

1.2 Einteilung in 4 Risikoklassen

Der EU AI Act unterscheidet vier Risikoklassen. Der risikobasierte Ansatz teilt KI-Systeme dabei in vier Kategorien:

- inakzeptables Risiko > verboten

- hohes Risiko

- geringes Risiko

- General Purpose-AI, also allgemeine, generative KI wie zB ChatGPT.

Nur Systeme mit hohem oder unannehmbarem Risiko unterliegen strengen Auflagen oder Verboten. Die meisten KI-Anwendungen gelten als risikoarm und müssen primär Transparenzpflichten erfüllen.

2. Der Zeitplan

1. August 2024:

Der AI Act wurde im Amtsblatt der EU veröffentlicht und trat offiziell in Kraft.2. Februar 2025:

Artikel 4 verpflichtet Unternehmen seit dem 2.2.2025, KI-Kompetenz aufzubauen – bei allen Mitarbeitenden, die mit KI arbeiten. Das Verbot von KI-Systemen mit unannehmbarem Risiko gemäß Artikel 5 wurde ebenso wirksam: Unternehmen müssen sicherstellen, dass derartige Systeme nicht mehr eingesetzt werden.2. Mai 2025:

Die EU-Kommission veröffentlicht Verhaltenskodizes für allgemeine KI-Modelle, die innerhalb von drei Monaten wirksam werden sollen.2. August 2025:

Mitgliedstaaten müssen nationale Behörden benennen und deren Kontaktdaten veröffentlichen. Zudem treten Verpflichtungen für Anbieter von allgemeinen KI-Modellen in Kraft.2. August 2026:

Die meisten Bestimmungen des AI Acts werden anwendbar, einschließlich der Anforderungen für Hochrisiko-KI-Systeme.2. August 2027:

Alle verbleibenden Bestimmungen treten in Kraft, insbesondere für bereits regulierte KI-Systeme wie medizinische Geräte.

3. Die Analyse

3.1 Welche Anforderungen treffen auf mein Unternehmen zu?

Entscheidend ist, ob ein Unternehmen KI anbietet oder nutzt – und wenn ja, in welche Risikoklasse das System fällt. Bin ich nicht sicher, ob die Software, die ich nutze, KI einsetzt, wende ich mich an den Hersteller. Diesen befrage ich, in welcher der vier Risikokategorien er die Software einordnet.

3.2 Rollen im EU AI Act: Neben der Risikoklasse ist auch entscheidend, welche Rolle ein Unternehmen einnimmt.

Der EU AI Act folgt in seiner Logik der Produktsicherheitsregulierung: Hersteller (bzw. Anbieter) tragen die Hauptverantwortung, Nutzer (Betreiber) müssen regelkonform anwenden. Die meisten Unternehmen agieren als Betreiber – mit deutlich weniger Pflichten als Anbieter.

- Anbieter: Entwickeln oder vermarkten KI-Systeme unter eigenem Namen. Beispiel: Jasper entwickelt eine Plattform für KI-generierte Marketingtexte.

- Betreiber: Nutzen bestehende KI-Systeme intern, ohne sie weiterzuentwickeln oder zu vertreiben.

Beispiele: Wir als Agentur nutzen ChatGPT für Werbetexte oder erstellen Produktbilder mit Midjourney.

4. Die Umsetzung

4.1 Pflichten für Unternehmen, die KI einsetzen

4.1.1 Schulungspflicht (seit 02.02.2025): Artikel 4 verpflichtet Unternehmen, KI-Kompetenz aufzubauen – bei allen Mitarbeitenden, die mit KI arbeiten.

- Wer muss geschult werden? Alle Mitarbeitenden, die beruflich KI nutzen – egal ob Azubi, Büroangestellte oder Produktionsmitarbeitende.

- Was soll vermittelt werden? Grundlagen der KI: z. B. wie funktionieren große Sprachmodelle?

- Anwendung und Grenzen von KI, z.B. ethische und gesellschaftliche Aspekte: z. B. Diskriminierung, Vorurteile, mangelnde Transparenz

- Wie kann geschult werden? Onlinekurse, Inhouse-Workshops mit internen Fachleuten oder externen Anbietern. Der AI Act schreibt keine bestimmte Form oder Zertifizierung vor.

- Wie wird die Schulung nachgewiesen?

Kein formaler Nachweis gefordert. Aber: Bei rechtlichen Streitfällen kann ein fehlendes Schulungskonzept negativ ausgelegt werden.

Empfehlung: Schulungskonzept dokumentieren und Teilnahme intern bestätigen (z. B. im Zeugnis oder durch Zertifikat).

Jetzt anfragen

KI-Schulung lt. EU AI Act

Online-Webinar oder Inhouse-Seminar: Fragen Sie jetzt Ihre KI-Schulung an. Individuelle Formate möglich.

KI-Schulung anfragenÜbersicht KI-Schulungen4.1.2 Transparenzpflicht bei generativer KI

Was muss beachtet werden?

- Texte müssen nicht gekennzeichnet werden, wenn sie redaktionell bearbeitet wurden.

- Kennzeichnungspflicht gilt für Inhalte, die „öffentlich relevante Informationen“ betreffen.

- Deepfakes (real wirkende, KI-generierte Darstellungen von Personen oder Ereignissen) müssen gekennzeichnet werden.

Wie sieht das in der Praxis aus?

- Kreative, künstlerische Inhalte brauchen keine Kennzeichnung

- Werbung, PR oder Corporate Content mit täuschend echten KI-Bildern oder -Videos: Kennzeichnung empfohlen.

4.1.3 Bei Hochrisiko-KI: Strenge Anforderungen

Hier greift der volle Katalog: Risikoanalysen, Dokumentation, Aufsicht, Auditierbarkeit etc.

Für die meisten Marketing- und Business-Anwendungen ist das aber nicht relevant.

4.2 Datenschutz bleibt relevant

Der EU AI Act ersetzt nicht die DSGVO.

Sobald personenbezogene Daten verarbeitet werden, gelten weiterhin alle datenschutzrechtlichen Vorgaben – unabhängig davon, ob KI im Spiel ist oder nicht.

5. Best Practice Leitfaden

10 Best Practice Tipps für Ihre KI-Compliance:

- Listen und analysieren Sie alle genutzten KI-Anwendungen.

- Ermitteln Sie die anwendbaren Regelungen und Pflichten, inkl. Risikoklassifizierung.

- Daraus ergibt sich eine umfassende KI-Compliance-Organisation (inklusive Produktsicherheit, Datenschutz, Urheberrecht, etc.) beachten

- Ggf. haben Sie zusätzlich unternehmensinterne Richtlinie zur Steuerung von KI > also alles, was in den Bereich. Governance fällt

- Ergreifen Sie notwendige technische Maßnahmen wie Zugriffsbeschränkungen, Rollenvergaben und mehr.

- Starten Sie organisatorische Maßnahmen wie KI-Arbeitsgruppen oder die Erstellung von KI-Leitfäden.

- Entwickeln Sie eine KI-Strategie individuell für Ihr Unternehmen oder Ihre Abteilung. Legen Sie dabei auch

Richtlinien zum Einsatz von KI fest: Welche KI-Systeme wollen Sie einsetzen, welche aus ethischen oder anderen Gründen bewusst nicht. - Kommunizieren Sie proaktiv mit Mitarbeitern, Kunden, Dienstleistern über den Einsatz von KI in Ihrem Unternehmen.

- Schulen Sie alle Mitarbeitenden, die KI-Software nutzen, und sei es nur ChatGPT und Co: Wie gerade schon gelesen, besteht die gesetzliche Verpflichtung, dass KI-Anwender im Unternehmen über ausreichende Kompetenzen verfügen müssen.

- Organisieren das Monitoring, also Überwachen und auch das regelmäßige Überprüfen, ob Änderungen nötig sind.

6. Welche Strafen drohen?

- Bei Verstößen gegen Transparenzpflichten:

- Bußgeld bis zu 15 Mio. € oder 3 % des Jahresumsatzes, für Startups und KMU gilt immer der niedrigere Betrag.

- Erste Kontrollen werden vermutlich auf Hochrisikofälle fokussiert – ähnlich wie bei der DSGVO

Angebot anfragen

KI-Schulung mit Zertifikat

Online-Webinar oder Inhouse-Seminar: Fragen Sie jetzt Ihre KI-Schulung an. Individuelle Formate möglich.

KI-Schulung anfragenÜbersicht KI-Schulungen